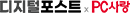

[smartPC사랑=임병선 기자] 인텔의 연례 고객 및 파트너 컨퍼런스인 인텔 비전 2024(Intel Vision 2024)에서 인텔은 기업용 생성형 AI(GenAI)를 위한 성능, 개방성 및 선택권을 제공할 인텔 가우디 3(Intel Gaudi 3) 가속기와 함께 생성형 AI 도입 가속화를 위한 새로운 개방형 스케일러블 시스템 스위트, 차세대 제품 및 전략적 협력을 발표했다. 지난해 생성형 AI 프로젝트를 성공적으로 업무에 도입한 기업이 10%에 불과한 가운데, 인텔의 최신 제품들은 기업이 AI 이니셔티브를 확장하는데 직면한 도전 과제에 대응할 수 있다.

인텔 CEO 팻 겔싱어(Pat Gelsinger)는 “혁신은 전례없는 속도로 발전하고 있으며, 반도체가 이 모든 것을 가능하게 한다. 또한 모든 기업이 빠르게 AI 기업으로 거듭나고 있다”라며 “인텔은 PC부터 데이터센터, 엣지에 이르기까지 기업 전반의 모든 곳에 AI를 가능하게 하고 있다. 인텔의 최신 가우디, 제온 및 코어 Ultra 플랫폼은 변화하는 고객과 파트너의 요구를 충족하고 앞으로의 엄청난 기회를 활용할 수 있도록 유연한 솔루션 세트를 제공하고 있다”고 밝혔다.

기업은 생성형 AI를 파일럿 단계에서 업무에 적용하는 것으로 확장하고자 한다. 이를 위해서는 복잡성, 단편화, 데이터 보안 및 규정 준수 요구 사항을 해결하면서 인텔 가우디 3(Intel Gaudi 3) AI 가속기와 같이 성능, 비용 및 전력 효율성이 뛰어난 프로세서를 기반으로 구축된 즉시 도입 가능한 솔루션이 필요하다.

AI 학습 및 추론용 가우디 3 발표

인텔 가우디 3 AI 가속기는 공통 표준을 따르는 이더넷을 통해 최대 수만 개의 가속기를 연결해 AI 시스템을 구동한다. 인텔 가우디 3는 BF16에 대해 4배 더 많은 AI 컴퓨팅 및 기존 모델 대비 1.5배 커진 메모리 대역폭을 지원한다. 이 가속기는 생성형 AI를 대규모로 배포하려는 글로벌 기업에게 AI 학습 및 추론 분야에서 획기적인 도약을 지원할 수 있다.

엔비디아 H100과 비교하여 인텔 가우디 3는 70억개 및 130억개의 매개변수가 있는 라마2(Llama2) 모델과 GPT-3 1750억개 매개변수 모델 전체에서 평균 50% 더 빠른 학습 시간을 제공할 것으로 예상한다. 또한 인텔 가우디 3 가속기 추론 처리량은 평균적으로 H100보다 50%, 전력 효율성의 경우 라마(Llama) 70억개 및 700억개 매개변수와 팔콘(Falcon) 1800억개 매개변수 모델에서 평균 40% 더 우수할 것으로 예상한다.

인텔 가우디 3는 개방형 커뮤니티 기반 소프트웨어와 업계 표준 이더넷 네트워킹을 제공한다. 또한 기업은 싱글 노드에서 클러스터, 슈퍼 클러스터, 수천 개의 노드가 있는 메가 클러스터로 유연하게 확장할 수 있으며, 최대 규모의 추론, 미세 조정 및 학습을 지원한다.

인텔 가우디 3는 2024년 2분기에 델 테크놀로지스(Dell Technologies), HPE, 레노버(Lenovo), 슈퍼마이크로(Supermicro)를 비롯한 OEM 시스템에 탑재될 예정이다. 더 자세한 사항은 가우디 3 보도자료에서 확인할 수 있다.

인텔 AI 솔루션으로 고객 가치 창출

인텔은 하드웨어, 소프트웨어, 프레임워크, 툴 등을 포함한 개방형 스케일러블 AI 시스템에 대한 전략을 제시했다. 인텔의 이러한 접근법은 기업별 생성형 AI(GenAI) 요구 사항을 충족하는 솔루션을 제공하기 위함으로 다양하고 개방적인 AI 생태계를 가능케 한다. 여기에는 장비 제조업체, 데이터베이스 공급자, 시스템 통합업체, 소프트웨어 및 서비스 공급자 등이 포함된다. 또한, 기업 고객이 이미 알고 신뢰하는 생태계 파트너 및 솔루션을 활용할 수 있는 부분도 장점으로 꼽힌다.

인텔은 다양한 업계의 기업 고객 및 파트너들과 새롭고 혁신적인 생성형 AI 응용 프로그램을 개발하기 위해 인텔 가우디를 활용해 협력하고 있음을 밝혔다.

네이버(NAVER): 클라우드에서부터 온디바이스까지 첨단 AI 서비스를 전 세계에 배포하기 위해 강력한 LLM 모델을 개발, 네이버는 대규모 트랜스포머(Transformer) 아키텍쳐 기반 모델의 컴퓨팅 작업을 뛰어난 와트 당 퍼포먼스로 실행하는데 인텔 가우디의 기본 역량을 확인

보쉬(Bosch): 자사 기반 모델 개발을 포함한 스마트 제조의 가능성을 모색, 합성 데이터 세트 생성과 더불어 자동 광학 검사와 같은 견고하고 분산된 트레이닝 세트 제공

IBM: watsonx.data 데이터 스토어에 5세대 인텔 제온 (Intel Xeon) 프로세서를 적용하고 인텔과 함께 watsonx 플랫폼에 인텔 가우디 가속기 검증

올라/크루트림(Ola/Krutrim): 10개의 언어로 인도 최초의 생성형 AI 역량을 갖춘 기초 모델을 훈련하고 업데이트하여 시장 대비 1.5배에서 2배 더 비용 및 성능 효율적인 솔루션 제공, 크루트림은 인텔 가우디 2 클러스터를 통해 보다 큰 규모의 자사 기반 모델에 사전 학습 진행 중

닐슨IQ(NielsenIQ), 애드번트 인터내셔널(Advent International)의 포트폴리오 기업: 세계 최대의 소비자 구매 행동 데이터베이스에서 특정 분야별 LLM을 학습하게 하여 개인 정보 보호 기준을 엄격하게 준수하면서 동시에 고객 서비스 향상

시커(Seekr): 신뢰할 수 있는 AI 분야의 선두 주자로서 LLM 개발 및 생산 배포를 위해 인텔 타이버 개발자 클라우드(Intel Tiber Developer Cloud)에서 인텔 가우디 2, 인텔 맥스 시리즈 GPU 및 인텔 제온 프로세서를 활용해 생산 워크로드 개선

IFF: 식음료, 조향 및 생물 과학 분야의 글로벌 리더로서 생성형 AI 및 디지털 트윈 기술을 통해 고급 효소 설계 및 발효 공정 최적화를 위한 통합 디지털 생물학 워크플로우 구축

CtrlS 그룹: 인도 기반 고객을 위한 AI 슈퍼컴퓨터 구축 및 CtrlS 클라우드 서비스를 가우디 클러스터로 확장하기 위해 협력

바르티 에어텔(Bharti Airtel): 에어텔은 인텔의 최첨단 기술을 도입, 풍부한 통신 데이터를 활용하여 AI 역량을 강화하고 고객 경험 향상시킬 계획. 이러한 구축은 기술 혁신의 선두에 서서 빠르게 진화하는 디지털 환경에서 새로운 수익원을 창출하려는 에어텔의 노력에 부응.

랜딩 AI(Landing AI): 세포 분류 및 암 감지에 활용되는 분야별 대규모 비전 모델을 파인튜닝

로보플로우(Roboflow): 엔트-투-엔드 컴퓨터 비전 플랫폼을 위해 YOLOv5, YOLOv8, CLIP, SAM 및 ViT 모델의 생산 워크로드 실행

인포시스(Infosys): 차세대 디지털 서비스 및 컨설팅 분야의 글로벌 리더로써 4세대 및 5세대 인텔 제온 프로세서, 인텔 가우디 2 AI 가속기 및 인텔 코어 Ultra(Intel Core Ultra)를 포함한 인텔 기술을 생성형 AI 기술을 사용하여 비즈니스 가치를 가속화하는 AI 우선 서비스, 솔루션 및 플랫폼 세트인 인포시스 토파즈(Infosys Topaz)에 제공하기 위해 전략적 협력 발표

추가로 구글 클라우드(Google Cloud), 탈레스(Thales) 그리고 코히시티(Cohesity) 또한 클라우드 환경에서의 기밀 컴퓨팅 역량을 활용할 수 있도록 인텔과의 협력을 발표했다. 여기에는 인텔 TDX(Intel Trust Domain Extensions), 인텔 SGX(Intel Software Guard Extensions) 그리고 인텔의 보안 증명(Attestation) 기능들이 포함된다. 고객들은 신뢰할 수 있는 실행 환경(trusted execution environment, TEE)에서 AI 모델과 알고리즘을 실행하고 인텔의 기능들을 활용할 수 있다.

기업용 AI에서 개방형 플랫폼 개발을 위한 생태계 협력

인텔은 애니스케일(Anyscale), 아르큘8(Articul8), 데이터스택스(DataStax), 도미노(Domino), 허깅페이스(Hugging Face), KX 시스템즈(KX Systems), 마리아DB(MariaDB), MinIO, Qdrant, 레드햇(RedHat), 레디스(Redis), SAP, SAS, VMware, 옐로브릭(Yellowbrick), 질리즈(Zilliz)와 협력하여 엔터프라이즈 AI를 위한 개방형 플랫폼 개발 계획을 발표했다.

업계 전반적인 이번 노력은 동급 최고의 배포의 용이성, 성능 및 가치 면에서 최고의 개방형 멀티 벤더 생성형 AI 시스템을 개발하는 것을 목표로 한다. RAG는 안전한 표준 인텔 제온 기반 솔루션에서 실행되는 기업의 방대한 기존 자산 데이터 소스를 오픈 LLM 기능을 보강함으로써 기업 내 생성형 AI 사용을 가속화할 수 있도록 지원한다.

이번 협력의 초기 단계로 인텔은 생성형 AI 파이프라인에 대한 안전한 인텔 제온 및 가우디 기반 솔루션의 레퍼런스 구현을 공개하고, 기술 개념 프레임워크(technical conceptual framework)를 게시하며, 생태계 개발, RAG 및 향후 파이프라인의 검증을 위해 인텔 타이버 개발자 클라우드(Intel Tiber Developer Cloud)에 인프라 용량을 지속적으로 추가할 것이다. 인텔은 기업의 채택과 솔루션 적용분야를 확대하고, 비즈니스 성과를 촉진하기 위한 이러한 개방적인 노력에 더 많은 생태계의 참여를 장려하고 있다.

인텔의 확장된 AI 로드맵 및 개방형 생태계 접근방식

인텔은 인텔 가우디 3 가속기 외에도 엔터프라이즈 AI의 모든 부문에 걸쳐 차세대 제품 및 서비스에 대한 업데이트를 발표했다.

새로운 인텔 제온 6(Intel Xeon 6) 프로세서: 인텔 제온 프로세서는 폐쇄적 데이터를 사용하여 비즈니스에 특화된 결과를 생성하는 RAG를 포함한 최신 생성형 AI 솔루션을 실행할 수 있는 성능 효율적인 솔루션을 제공한다. 인텔은 데이터센터, 클라우드 및 엣지용 차세대 프로세서를 위한 새로운 브랜드로 인텔 제온 6를 소개했다.

새로운 E-코어 기반 탁월한 효율성을 제공하는 인텔 제온 6 프로제서는 이번 분기 출시되며, P-코어 기반 인텔 제온 6는 향상된 AI 성능을 제공할 예정으로 E-코어 프로세서 출시에 이어 곧 출시할 예정이다.

E-코어 기반 인텔 제온 6 프로세서(코드명 시에라 포레스트):

2세대 인텔 제온 프로세서 대비 와트 당 성능 2.4배, 랙 밀도 2.7배 향상

고객들은 구형 시스템을 약 3대 1의 비율로 교체할 수 있어 에너지 소비를 대폭 낮추고 지속가능성 목표6 달성에 도움을 받을 수 있다.

P-코어 기반 인텔 제온 6 프로세서(코드명 그래나이트 래피즈):

MXFP4 데이터 형식에 대한 소프트웨어 지원을 통합하여 다음 토큰 지연 시간을 FP16을 사용하는 4세대 제온 대비 최대 6.5배까지 단축하고 700억개 매개변수의 라마-2 모델을 실행할 수 있다.

클라이언트, 엣지 및 연결성: 인텔은 클라이언트에 대한 모멘텀과 엣지 및 연결성을 위한 로드맵 업데이트를 발표했다.

인텔 코어 Ultra 프로세서는 생산성, 보안 및 콘텐츠 제작을 위한 새로운 기능을 제공하며, 기업들이 PC를 교체하는 데 큰 동기를 부여한다. 인텔은 2024년에 울트라 PC부터 휴대용 게이밍 디바이스까지 230개 이상의 디자인으로 4천만대의 AI PC를 출하할 것으로 예상하고 있다.

2024년 출시될 차세대 인텔 코어 Ultra 클라이언트 프로세서 제품군(코드명 루나레이크)은 차세대 AI PC를 위해 플랫폼 기준 100 TOPS 이상, , 신경처리장치(NPU)에서 45TOPS 이상을 제공할 예정이다.

인텔은 유통, 산업 제조, 의료 등 주요 시장을 겨냥한 인텔 코어 Ultra, 인텔 코어, 인텔 아톰 프로세서, 인텔 아크 GPU 제품군 전반에 걸친 새로운 엣지용 칩을 발표했다. 인텔의 엣지 AI 포트폴리오에 추가되는 모든 제품은 이번 분기에 출시할 예정이며, 올해 인텔 타이버 엣지 플랫폼(Intel Tiber Edge Platform)에서 지원할 예정이다.

인텔은 울트라 이더넷 컨소시엄(UEC)을 통해 AI 패브릭을 위한 개방형 이더넷 네트워킹을 선도하며 다양한 AI 최적화 이더넷 솔루션을 선보이고 있다. 대규모 스케일업 및 스케일아웃 AI 패브릭을 위해 설계된 이러한 혁신은 매 세대마다 규모가 수십 배씩 확장되는 점점 더 방대해지는 모델들을 위한 학습과 추론을 가능하게 한다. 이 라인업에는 인텔 AI 네트워크 인터페이스 카드(NIC), XPU에 통합하기 위한 AI 연결 칩렛, 가우디 기반 시스템, 인텔 파운드리용 다양한 소프트 및 하드 레퍼런스 AI 인터커넥트 디자인이 포함된다.

인텔 타이버 비즈니스 솔루션 포트폴리오

인텔은 생성형 AI를 포함한 엔터프라이즈 소프트웨어 및 서비스 배포를 간소화하기 위한 인텔 타이버 비즈니스 솔루션 포트폴리오(Intel Tiber portfolio of business solutions)를 공개했다.

통합된 환경을 통해 기업과 개발자는 보안, 규정 준수 또는 성능에 영향을 주지 않으면서도 필요에 맞는 솔루션을 쉽게 찾고, 혁신을 가속화하며, 가치를 실현할 수 있다. 고객은 오늘부터 인텔 타이버 포트폴리오를 만나볼 수 있으며, 출시는 2024년 3분기로 예정되어 있다. 자세한 내용은 인텔 타이버 웹사이트에서 확인할 수 있다.

인텔이 비전 2024에서 발표한 내용은 AI에 접근 가능하고 개방적이며 안전하게 사용할 수 있도록 하겠다는 인텔의 약속을 강조한다. 인텔은 이러한 새로운 솔루션과 협업을 통해 AI 혁신을 선도하고, 전 세계 모든 기업에게 전례 없는 가치를 제공할 준비가 되어 있다.

네이버클라우드 하정우 AI 이노베이션 센터장은 이번에 발표한 네이버-인텔 협력에 대해 “네이버는 차세대 LLM 서비스를 위해 가장 강력하고, 혁신적이며 안전한 멀티모달 LLM모델을 개발하고 배포하겠다는 비전을 가지고 있다. 인텔과 긴밀하게 협력하여 스타트업과 학계를 포함하는 생태계로 확산해 혁신적인 생성형 AI 모델과 애플리케이션을 개발하도록 지원하고 글로벌 기업고객에게 LLM학습 클라우드 인스턴스를 제공할 것”이라며, “이를 위해 가우디를 검증하고 이 결과를 통해 가우디 기반 LLM 학습 인프라를 구축할 것을 기대한다”고 밝혔다.